Burn Wound Severity Detection using Segmentation Model: A Comparative Study Between U-NET and YOLOv8

Main Article Content

Abstract

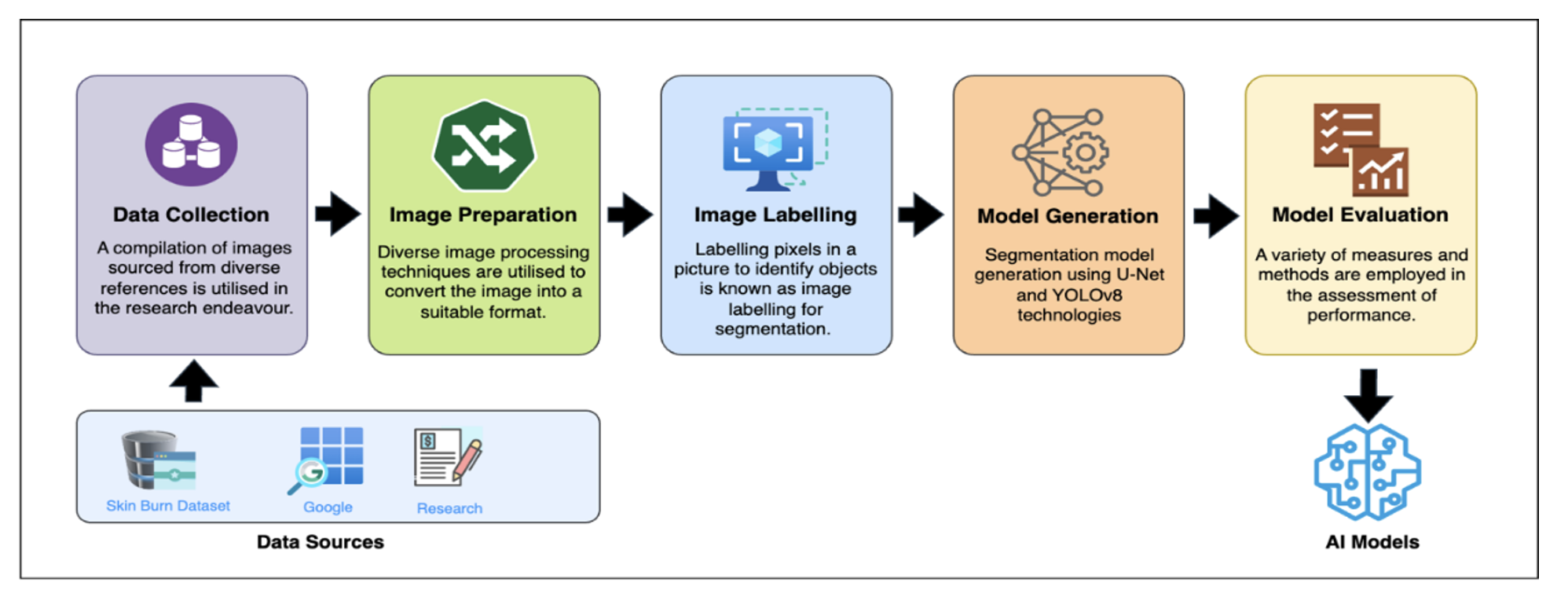

This research focuses on detecting burn severity using an area of interest detection approach. The burn areas are categorized into three levels: (i) first-degree burns, (ii) second-degree burns, and (iii) third-degree burns, each with distinct visual characteristics. To detect burn severity, artificial intelligence (AI) techniques were applied through the development of two models: U-Net and YOLOv8. A dataset of 2,000 images representing all three levels of burns was used in the experiments. The goal was to compare the performance of U-Net, a widely used model for segmenting areas of interest, with YOLOv8, a newer model introduced in 2023. Experimental results show that the best performance of U-Net achieved an accuracy of 79.1% and a loss value of 79.8%. In contrast, YOLOv8 achieved its best result with an mAP@0.5 of 0.657, a segmentation loss of 3.231, and a classification loss of 1.961. These results represent the optimal performance of both models in this study.

Article Details

This work is licensed under a Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International License.

All authors need to complete copyright transfer to Journal of Applied Informatics and Technology prior to publication. For more details click this link: https://ph01.tci-thaijo.org/index.php/jait/copyrightlicense

References

Ameli, Z., Nesheli, S. J., & Landis, E. N. (2023). Deep learning-based steel bridge corrosion segmentation and condition rating using mask RCNN and YOLOv8. Infrastructures, 9(1), 3. https://doi.org/10.3390/infrastructures9010003

Chang, C. W., Lai, F., Christian, M., Chen, Y. C., Hsu, C., Chen, Y. S., Chang, D. H., Roan, T. L., & Yu, Y. C. (2021). Deep learning–assisted burn wound diagnosis: Diagnostic model development study. JMIR Medical Informatics, 9(12), e22798. https://doi.org/10.2196/22798

Chauhan, J., & Goyal, P. (2021). Convolution neural network for effective burn region segmentation of color images. Burns, 47(4), 854–862. https://doi.org/10.1016/j.burns.2020.08.016

Che, S., Li, Z., Shi, Z., Gao, M., & Tang, H. (2023). Research on an underwater image segmentation algorithm based on YOLOv8. Journal of Physics: Conference Series, 2644(1), 012013. https://doi.org/10.1088/1742-6596/2644/1/012013

Cirillo, M. D., Mirdell, R., Sjöberg, F., & Pham, T. D. (2021). Improving burn depth assessment for pediatric scalds by AI based on semantic segmentation of polarized light photography images. Burns, 47(7), 1586–1593. https://doi.org/10.1016/j.burns.2021.01.011

Connolly, M., & Gangahar, R. (2021). 640 Improving junior doctors’ knowledge and confidence in assessment, management and referral of burns patients in the Emergency Department, Royal Oldham Hospital. British Journal of Surgery, 108(Supplement_6). https://doi.org/10.1093/bjs/znab259.703

Hamamoto, R., Suvarna, K., Yamada, M., Kobayashi, K., Shinkai, N., Miyake, M., Takahashi, M., Jinnai, S., Shimoyama, R., Sakai, A., Takasawa, K., Bolatkan, A., Shozu, K., Dozen, A., Machino, H., Takahashi, S., Asada, K., Komatsu, M., Sese, J., & Kaneko, S. (2020). Application of artificial intelligence technology in Oncology: Towards the establishment of precision medicine. Cancers, 12(12), 3532. https://doi.org/10.3390/cancers12123532

Haleem, A., Javaid, M., & Khan, I. H. (2019). Current status and applications of artificial intelligence (AI) in medical field: An overview. Current Medicine Research and Practice, 9(6), 231–237. https://doi.org/10.1016/j.cmrp.2019.11.005

Jiao, C., Su, K., Xie, W., & Ye, Z. (2019). Burn image segmentation based on mask regions with convolutional neural network deep learning framework: More accurate and more convenient. Burns & Trauma, 7. https://doi.org/10.1186/s41038-018-0137-9

Kotecha, V. R., Opot, N. E., & Nangole, F. (2022). Assessment and management of pain in patients sustaining burns at Emergency Department Kenyatta National Hospital, Kenya: A descriptive study. Trauma Care, 2(1), 79–86. https://doi.org/10.3390/traumacare2010007

Lee, Y., Sim, W., Park, J., & Lee, J. (2022). Evaluation of hyperparameter combinations of the U-Net model for land cover classification. Forests, 13(11), 1813. https://doi.org/10.3390/f13111813

Liang, J., Li, R., Wang, C., Zhang, R., Yue, K., Li, W., & Li, Y. (2022). A spiking neural network based on retinal ganglion cells for automatic burn image segmentation. Entropy, 24(11), 1526. https://doi.org/10.3390/e24111526

Liszka, S. (2023). Evaluation of tree planting using computer vision models YOLO and U-Net [Master Thesis, Umeå University]. Retrieved from https://urn.kb.se/resolve?urn=urn:nbn:se:umu:diva-214842

Markiewicz-Gospodarek, A., Kozioł, M., Tobiasz, M., Baj, J., Radzikowska-Büchner, E., & Przekora, A. (2022). Burn wound healing: Clinical complications, medical care, treatment, and dressing types: The current state of knowledge for clinical practice. International Journal of Environmental Research and Public Health, 19(3), 1338. https://doi.org/10.3390/ijerph19031338

Moura, F. S. E., Amin, K., & Ekwobi, C. (2021). Artificial intelligence in the management and treatment of burns: a systematic review. Burns & Trauma, 9. https://doi.org/10.1093/burnst/tkab022

Naqvi, M., Gilani, S. Q., Syed, T., Marques, O., & Kim, H.-C. (2023). Skin cancer detection using deep learning—A review. Diagnostics, 13(11), 1911. https://doi.org/10.3390/diagnostics13111911

Pandya, M. D., Shah, P. D., & Jardosh, S. (2019). Medical image diagnosis for disease detection: A deep learning approach. U-Healthcare Monitoring Systems, 37–60. https://doi.org/10.1016/b978-0-12-815370-3.00003-7

Pabitha, C., & Vanathi, B. (2020). Densemask RCNN: A hybrid model for skin burn image classification and Severity grading. Neural Processing Letters, 53(1), 319–337. https://doi.org/10.1007/s11063-020-10387-5

Román, K., Llumiquinga, J., Chancay, S., & Morocho-Cayamcela, M. E. (2023). Hyperparameter tuning in a dual channel U-Net for medical image segmentation. Information and Communication Technologies, 337–352. https://doi.org/10.1007/978-3-031-45438-7_23

Şevik, U., Karakullukçu, E., Berber, T., Akbaş, Y., & Türkyılmaz, S. (2019). Automatic classification of skin burn colour images using texture‐based feature extraction. IET Image Processing, 13(11), 2018–2028. Portico. https://doi.org/10.1049/iet-ipr.2018.5899

Singh, N. J., & Nongmeikapam, K. (2022). Semantic segmentation of satellite images using Deep-Unet. Arabian Journal for Science and Engineering, 48(2), 1193–1205. https://doi.org/10.1007/s13369-022-06734-4

Suha, S. A., & Sanam, T. F. (2022). A deep convolutional neural network-based approach for detecting burn severity from skin burn images. Machine Learning with Applications, 9, 100371. https://doi.org/10.1016/j.mlwa.2022.100371

Toussaint, J., & Singer, A. J. (2014). The evaluation and management of thermal injuries: 2014 update. Clinical and Experimental Emergency Medicine, 1(1), 8–18. https://doi.org/10.15441/ceem.14.029

Son Tran, H., Hoang Le, T., & Thanh Nguyen, T. (2016). The degree of skin burns images recognition using convolutional neural network. Indian Journal of Science and Technology, 9(45). https://doi.org/10.17485/ijst/2016/v9i45/106772

Wang, C., Anisuzzaman, D. M., Williamson, V., Dhar, M. K., Rostami, B., Niezgoda, J., Gopalakrishnan, S., & Yu, Z. (2020). Fully automatic wound segmentation with deep convolutional neural networks. Scientific Reports, 10(1). https://doi.org/10.1038/s41598-020-78799-w